Getty Images, eine der größten Bildagenturen der Welt, verklagte 2023 Stability AI, das Unternehmen hinter der generativen KI Stable Diffusion, wegen angeblicher missbräuchlicher Verwendung geschützter Bilder. Dieser öffentlichkeitswirksame Fall hat nicht nur für Unsicherheit im Rechtsbereich im Zusammenhang mit KI gesorgt, sondern auch ein Rechtsvakuum aufgezeigt, für das es noch keine konkrete Regelung auf europäischer Ebene gibt.

Die fortschreitende Verbreitung von Künstlicher Intelligenz (KI), Internet of Things (IoT) und Big Data bringt nicht nur Innovationen, sondern auch eine Vielzahl an rechtlichen Fragestellungen mit sich. In Timo Schutts umfassendem Vortrag zu den rechtlichen Anforderungen an KI, IoT und Big Data wurden die Herausforderungen und Erwartungen in Bezug auf die rechtlichen Konsequenzen dieser Technologien beleuchtet.

Haftung und Urheberecht im KI-Bereich

KI-Systeme wie ChatGPT und bildgenerierende Algorithmen stehen nicht nur positiv im Rampenlicht, sondern auch im Fokus von Rechtsstreitigkeiten. Themen wie fehlerhaftes KI-Training (diskriminierende KI), Generierung von Fake News und Urheberrechtsverletzungen werfen die Frage auf: Wer trägt die Verantwortung für das Handeln von KI? Wer haftet für sie?

Das deutsche Haftungssystem, das auf individuellem Fehlverhalten und einem klaren Schaden basiert, stößt hier an seine Grenzen. Die Haftung von Menschen hinter der KI und die potenzielle Haftungslücke bei autonom agierenden KI-Systemen sind juristisch komplexe Fragen. Darüber hinaus gibt es täglich Klagen wie die der New York Times im Jahr 2023 wegen der Verwendung ihrer Artikel und Berichte für das Training von KI-basierten Chatbots.

Die KI als Urheberrecht-Verletzungsmaschine zu betrachten, bringt weitere rechtliche Nuancen hervor. Während das Training von KI nach deutschem Urheberrecht grundsätzlich zulässig ist, bleibt die Frage nach der Urheberschaft von KI-generierten Inhalten offen. Gegenwärtig schützt das Recht nur menschliche Schöpfungen, doch künftige KI-Verordnungen könnten Richtlinien zur Kennzeichnung von KI-generierten Werken einführen.

Datenschutz und Sicherheit in der KI-Welt

In der Welt der Künstlichen Intelligenz (KI) ist Datenschutz von entscheidender Bedeutung, insbesondere wenn es um fortschrittliche Modelle wie ChatGPT geht, die auf Grundlage von riesigen Datenmengen trainiert wurden. Privacy by Design und by Default sollte die Grundlage für jede KI-Entwicklung sein, mit klarer Speicherbegrenzung und einer konsequenten Datenminimierung im Hinblick auf personenbezogene Daten. Unternehmen müssen sicherstellen, dass die Datenverarbeitung auf einer soliden rechtlichen Grundlage basiert, sei es durch Verträge oder ausdrückliche Einwilligung.

Der Umgang mit personenbezogenen Daten unterliegt strengen Anforderungen, darunter ein grundsätzliches Verbot automatisierter Entscheidungsfindungen mit rechtlicher Wirkung ohne klare Vertragsgenehmigung oder ausdrückliche Einwilligung. Verstöße gegen Datenschutzrichtlinien können drastische Sanktionen nach sich ziehen, darunter Bußgelder von bis zu 20 Millionen Euro oder 4% des weltweiten Jahresumsatzes, je nachdem, welcher Betrag höher ist. Unternehmen sollten sich bewusst sein, dass auch materieller und immaterieller Schadensersatz von betroffenen Personen droht. Eine Datenschutz-Folgenabschätzung ist zwingend erforderlich, um sicherzustellen, dass der Einsatz von KI den höchsten Datenschutzstandards entspricht. In diesem komplexen Umfeld sind ein umfassendes Verständnis und die Einhaltung strenger Datenschutzrichtlinien unerlässlich.

Herausforderungen von IoT und Big Data

Die Vernetzung durch IoT und die Verarbeitung von Big Data stellen weitere Herausforderungen dar. Das Telekommunikations-Telemedien-Datenschutz-Gesetz (TTDSG) legt klare Regeln für den Zugriff auf vernetzte Geräte fest. Datenschutz-Folgenabschätzungen werden in diesem Kontext immer wichtiger, insbesondere angesichts undurchsichtiger Handlungen und Entscheidungen, wie sie bei Sprachassistenten wie Alexa auftreten.

KI-Verordnung: Regelungen und Risikobasierter Ansatz

Im April 2021 wurde der Vorschlag für die KI-Verordnung präsentiert. Nach intensiven Verhandlungen zwischen der Europäischen Kommission, dem Europäischen Parlament und dem Europäischen Rat wurde im Dezember 2023 eine Einigung im sogenannten Trilog erzielt. Im Februar 2024 erfolgte die Verabschiedung durch den Rat, doch der

finale Text wurde noch nicht offiziell veröffentlicht. Ein durchgesickertes Arbeitspapier Ende Januar 2024 gewährt jedoch Einblicke.

Die Verordnung wird voraussichtlich ab Mai 2026 in Kraft treten und basiert auf einem risikobasierten Ansatz mit vier Kategorien.

- KI-Systeme, die ein unannehmbares Risiko darstellen, wie Social Scoring Systeme oder solche, die Schwächen und Schutzbedürftigkeit von Menschen ausnutzen, werden verboten.

- Hochrisiko-KI-Systeme, darunter biometrische Identifizierung, Komponenten für kritische Infrastrukturen und risikobasierte Preisgestaltung in Versicherungen, unterliegen strengen Regulierungen.

- KI-Systeme für die Interaktion mit natürlichen Personen fallen unter ein begrenztes Risiko.

- Und solche mit minimalem oder keinem Risiko fallen nicht in den Anwendungsbereich der Verordnung.

Die Europäische Kommission behält sich das Recht vor, die Liste hochrisikobehafteter KI-Systeme zu erweitern.

Weitere Richtlinien

- EU-Richtlinie über KI-Haftung (in Bearbeitung)

Diese Richtlinie etabliert klare Haftungsregeln für Schäden durch KI-Systeme, um die Verantwortlichkeiten von Herstellern und Betreibern zu definieren und den Verbraucherschutz (Diskriminierung, Datenschutz usw.) zu stärken.

- EU-Produkthaftungsrichtlinie (in Bearbeitung)

Hier ist die Haftung von Herstellern für fehlerhafte Produkte festgelegt, einschließlich KI-gesteuerter Produkte, um Verbraucher:innen klare Rechtsansprüche auf Schadenersatz zu gewähren.

- EU-Data Governance-Act (Verordnung, die ab 2023 gilt)

Stärkt die Kontrolle und den sicheren Austausch von Daten, schafft einen rechtlichen Rahmen für Datenintermediäre und fördert transparenten Datenzugang zur Förderung von Innovation und Datenschutz.

- EU-Data Act (EU-Verordnung, die ab 2025 gelten wird)

Erleichtert den freien Fluss von Daten in der EU, etabliert einheitliche Regeln für die Datennutzung, stärkt den Datenschutz und schafft Vertrauen durch klare Bestimmungen für den Umgang mit Verbraucherdaten.

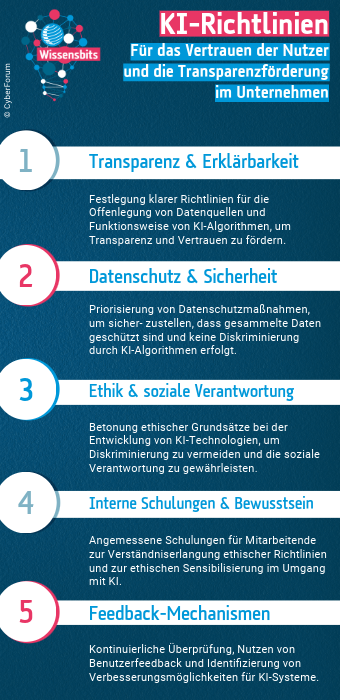

KI-Richtlinien für Unternehmen

- Transparenz und Erklärbarkeit

Festlegung klarer Richtlinien für die Offenlegung von Datenquellen und Funktionsweise von KI-Algorithmen, um Transparenz und Vertrauen zu fördern.

- Datenschutz und Sicherheit

Priorisierung von Datenschutzmaßnahmen, um sicherzustellen, dass gesammelte Daten geschützt sind und keine Diskriminierung durch KI-Algorithmen erfolgt.

- Ethik und soziale Verantwortung

Betonung ethischer Grundsätze bei der Entwicklung von KI-Technologien, um Diskriminierung zu vermeiden und die soziale Verantwortung zu gewährleisten.

- Interne Schulungen und Bewusstsein

Sicherstellung, dass Mitarbeitende über angemessene Schulungen verfügen, um ethische Richtlinien zu verstehen und ein Bewusstsein für ethische Fragen im Zusammenhang mit KI zu schaffen.

- Feedback-Mechanismen und kontinuierliche Verbesserung

Implementierung von Mechanismen zur kontinuierlichen Überprüfung, Nutzung von Benutzerfeedback und Identifizierung von Möglichkeiten zur Verbesserung von KI-Systemen.

Am 13. März 2024 verabschiedete das EU-Parlament das erste Gesetz über KI.

Die Inhalte dieses Wissensbits stammen aus einem Impulsvortrag im Rahmen des RoundTables Rechtliche Anforderungen an KI, Internet of Things und Big Data von Timo Schutt, Rechtsanwalt und Fachanwalt für IT-Recht in Karlsruhe.